Python 官方文档:入门教程 => 点击学习

SpringBoot Tomcat最大线程数与最大连接数 首先看看springboot内置的tomcat,该如何配置这两个参数 # 在配置文件中添加如下内容 # tomcat最大

首先看看springboot内置的tomcat,该如何配置这两个参数

# 在配置文件中添加如下内容

# tomcat最大线程数,默认为200

server.tomcat.max-threads=200

# tomcat最大连接数,默认为10000(网上的说法)

server.tomcat.max-connections=300为了方便理解,我这里使用了springboot编写了一个简单了的服务,包含一个模拟登录的接口,并使用jmeter进行测试,不了解jmeter如何使用的朋友可以翻看我的历史文章。部分代码如下

// java 代码

@RestController

@RequestMapping("/user")

public class UserController {

@Autowired

private UsersRepository usersRepository;

@PostMapping("/login")

public String login(Users user) throws InterruptedException {

// 这里将线程挂起3秒,方便观察结果

Thread.sleep(3000);

Users checkUser = usersRepository.findByName(user.getName());

if(checkUser == null)

return "用户不存在";

if(!checkUser.getPassword().equals(user.getPassword()))

return "密码错误";

System.out.println("用户:" + checkUser.getName() + ",登录成功");

return "登录成功";

}

}

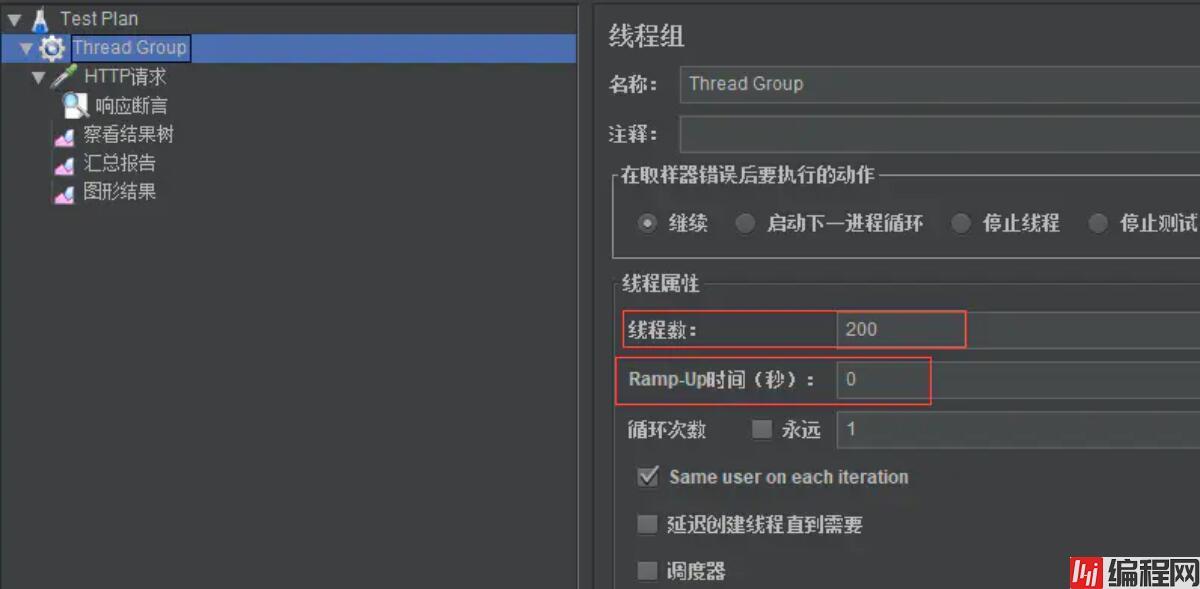

接下来,设置jmeter中的线程数,分别测试以下场景返回的结果

注意:我在java代码中添加将线程挂起3秒的语句,实际的响应时间应该减去3秒

设置jmeter并发请求数量为200

结果统计

结论:可以看到200个请求,平均响应时间为(3156-3000)=156ms,最小响应时间为23ms,最大响应时间为336ms,响应结果正常。

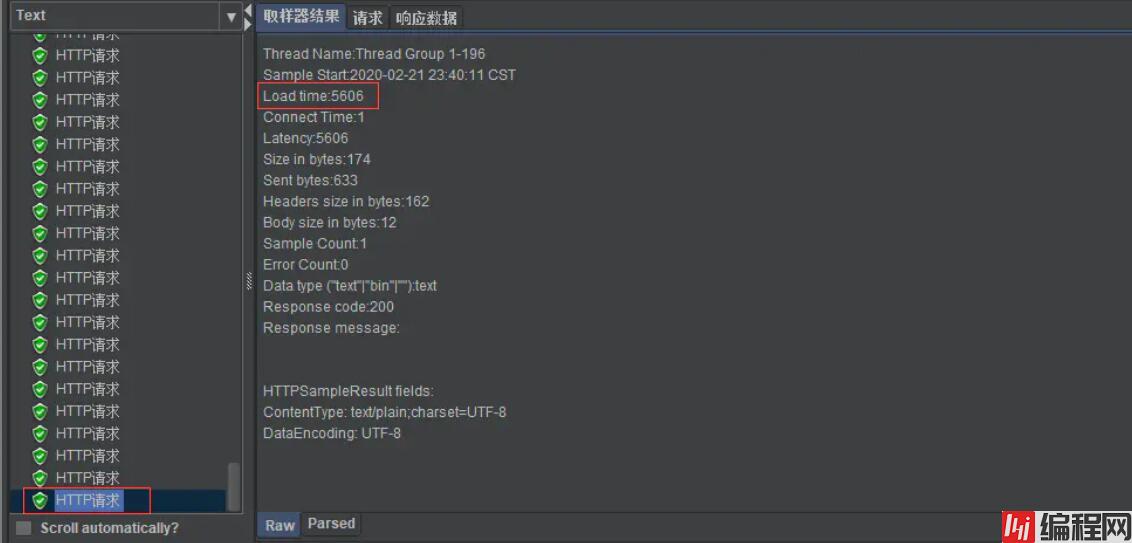

看了下,平均值,最小值好像没什么异常,但是最大值却去到了5606毫秒,接近6S的时间。为什么会有个接近6S的最大值,原因很简单,因为tomcat最大的线程数为200,201的并发请求量,超出了并发处理的数量200,多出来的1个请求,需要等待某个处理中的请求处理完成。

这里我翻看了jmeter中大部分的Http请求,验证了我的想法。大部分的http请求,响应时间都是3000多毫秒,只有最后一个响应的请求,响应的时间为5606毫秒,截图如下

异常数量由原本的百分之0变成37.45%

可以看到有大量的没有正常响应的http请求,原因很简单,因为超过了tomcat设置的最大连接数,服务器拒绝了该次请求的连接

每一次HTTP请求到达WEB服务器,Web服务器都会创建一个线程来处理该请求,该参数决定了应用服务同时可以处理多少个HTTP请求,tomcat默认为200;

当调用Web服务的HTTP请求数达到tomcat的最大线程数时,还有新的HTTP请求到来,这时tomcat会将该请求放在等待队列中,这个acceptCount就是指能够接受的最大等待数,默认100.如果等待队列也被放满了,这个时候再来新的请求就会被tomcat拒绝(connection refused);

这个参数是指在同一时间,tomcat能够接受的最大连接数。一般这个值要大于maxThreads+acceptCount。

根据公司用户量及机器配置信息,公司的最大连接数、最大线程数和最大等待数优化为:

#最大连接数

server.tomcat.max-connections=2000

#最大线程数

server.tomcat.max-threads=1000

#最大等待数

server.tomcat.accept-count=800

以上为个人经验,希望能给大家一个参考,也希望大家多多支持编程网。

--结束END--

本文标题: springboot tomcat最大线程数与最大连接数解析

本文链接: https://lsjlt.com/news/127602.html(转载时请注明来源链接)

有问题或投稿请发送至: 邮箱/279061341@qq.com QQ/279061341

2024-03-01

2024-03-01

2024-03-01

2024-02-29

2024-02-29

2024-02-29

2024-02-29

2024-02-29

2024-02-29

2024-02-29

回答

回答

回答

回答

回答

回答

回答

回答

回答

回答

0